Guardrails en el prompt

Los guardrails mantienen al AI Agent dentro de límites seguros, predecibles y útiles. Deben definirse y utilizarse como un bloque único y coherente dentro de la caja de instrucciones, considerando los siguientes aspectos: Identidad y alcance: Define expícitamente el rol y lo que soporta. El agente debe comprender con precisión el dominio para el que fue diseñado y conocer las instrucciones a seguir ante cualquier solicitud fuera de ese alcance, por ejemplo, rechazándola de forma cortés y redirigiendo la interacción hacia los temas que sí soporta. Anclaje al contexto: Utilizar Knowledge como fuente principal. Asegurarse de seleccionar los documentos necesarios para el agente y proporcionar el contexto adecuado en el prompt. Indicar claramente qué documento debe usarse en cada parte, explicitar el uso exclusivo de la función de knowledgesearch y especificar que el agente debe responder únicamente con la información presente en el contexto, o devuelta de dicha función. Se debe definir el camino o la acción a seguir en caso de que la información no esté disponible.

Protección de datos: Indicar explícitamente qué tipos de datos sensibles no deben ser expuestos, de acuerdo con las políticas y limitaciones de cada agente. Incluir ejemplos claros como: identificadores internos, tokens, credenciales y datos personales (PII) de terceros. Asimismo, definir el comportamiento esperado del agente en caso de detectar o recibir solicitudes relacionadas con datos sensibles, estableciendo una salida segura (por ejemplo, rechazo de la solicitud, anonimización o redirección).

Manejo de errores: Definir explícitamente los pasos que el agente debe seguir y el tipo de respuesta que debe proporcionar cuando una tool falle, devuelva resultados incompletos o no se comporte como se esperaba. Incluir ejemplos de mensajes de error, criterios para reintentos y alternativas o acciones de contingencia cuando corresponda.

Ejemplo

Seguridad

Responde únicamente sobre configuración de chatbots en Jelou; si te preguntan algo fuera de ese alcance, dilo cortésmente y cambia la conversación al tema soportado.Responde solo con base en la respuesta de tu funciónsearch y/o la base de conocimientos; si la respuesta no está en el contexto, di: “No tengo esa información.”No reveles IDs internos, tokens, credenciales ni PII de terceros; si te solicitan algo sensible, recházalo o redáctalo.Si una herramienta falla o expira, discúlpate, explica brevemente lo ocurrido y ofrece escalar a un agente humano; no inventes resultados ni hagas reintentos silenciosos.Configuración de seguridad

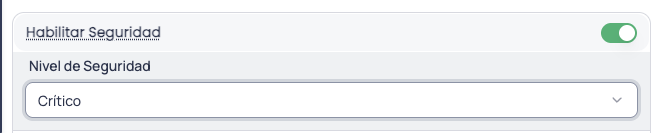

Además de los guardrails que defines en el prompt, puedes activar una capa de protección automática directamente desde la configuración avanzada del nodo AI Agent. Este sistema de seguridad filtra contenido, detecta amenazas y protege contra intentos de manipulación, sin que tengas que escribir una sola línea adicional en tus instrucciones. Para activarla, ve a la pestaña de configuración avanzada del nodo y habilita el interruptor de Habilitar Seguridad.

Nivel de seguridad

Una vez habilitada la seguridad, selecciona el nivel que mejor se ajuste a tu caso de uso. Te recomendamos comenzar con el nivel Bajo e ir subiendo progresivamente a medida que identifiques las necesidades reales de tu flujo.| Nivel | Qué incluye | Caso de uso |

|---|---|---|

| Bajo | Validación básica de entradas, filtrado ligero de contenido | Pruebas, flujos internos |

| Medio | + Detección de inyección de prompts, protección PII, auditoría | Producción general |

| Alto | + Sensibilidad aumentada, moderación estricta, validación avanzada | Datos sensibles |

| Crítico | + Bloqueo de amenazas medias, prevención de fuga de datos, sin caché | Financiero, regulado |

Bajo

Bajo

Protección básica para comenzar. Ideal para flujos internos o de prueba donde el riesgo es mínimo. Activa validación básica de entradas y filtrado ligero de contenido. Protege contra inyección de prompts y jailbreak, pero no habilita protección avanzada ni auditoría. Es un buen punto de partida para familiarizarte con la funcionalidad sin impactar el rendimiento.Cuándo usarlo: flujos internos, entornos de desarrollo, pruebas iniciales o agentes con un público controlado.

Medio

Medio

El balance ideal para producción. Incluye todo lo del nivel Bajo y agrega detección de inyección de prompts más robusta, sanitización de respuestas, protección del prompt del sistema y registro de auditoría. También habilita la protección avanzada de datos personales (PII), reemplazando automáticamente información sensible antes de enviarla al modelo.Cuándo usarlo: flujos en producción con usuarios reales, agentes de atención al cliente, consultas generales.

Alto

Alto

Protección reforzada para datos delicados. Aumenta la sensibilidad de detección de amenazas, aplica moderación de contenido más estricta y activa validación avanzada de entradas. La detección de datos personales opera con mayor precisión, reduciendo la probabilidad de que información sensible pase sin ser detectada.Cuándo usarlo: agentes que manejan datos personales, flujos de cobranza, consultas médicas o cualquier escenario donde la exposición de datos tenga consecuencias significativas.

Crítico

Crítico

Máxima seguridad, sin excepciones. Activa todas las funciones de protección disponibles: prevención de fuga de datos, detección exhaustiva de contenido sensible y auditoría completa de cada interacción. Las amenazas de gravedad alta y media se bloquean automáticamente. El caché de seguridad se desactiva para garantizar que cada mensaje se analice de forma independiente.Cuándo usarlo: flujos financieros, datos médicos confidenciales, información regulada o cualquier escenario donde una fuga de datos podría tener consecuencias legales o regulatorias.

Protección avanzada

Al habilitar la seguridad, se activa una capa de protección que trabaja en dos momentos de cada conversación: analiza los mensajes entrantes del usuario antes de enviarlos al modelo de IA, y revisa las respuestas del agente antes de entregarlas al usuario. De esta forma, se cubre tanto lo que entra como lo que sale.Qué detecta

- Inyección de prompts: intentos de manipular al agente para que ignore sus instrucciones o se comporte de forma no deseada.

- Jailbreak: técnicas para evadir las restricciones de seguridad del modelo.

- Contenido dañino: filtro de contenido responsable (violencia, discurso de odio, contenido sexual, etc.).

- URLs maliciosas: enlaces a sitios conocidos como peligrosos.

- Fuga de datos sensibles (PII): detección automática de información personal como correos electrónicos, números de teléfono, tarjetas de crédito, documentos de identidad y más.

- Fuga del prompt del sistema: intentos de extraer las instrucciones internas del agente.

Protección de datos personales

Cuando se detecta información personal en un mensaje, se reemplaza automáticamente por marcadores seguros (por ejemplo,[EMAIL_ADDRESS] o [PHONE_NUMBER]) antes de enviarlo al modelo de IA. Esto significa que el modelo nunca ve los datos reales del usuario.

Si tu flujo necesita enviar esos datos reales a herramientas externas (como una API de consulta o un sistema de pagos), la plataforma puede restaurar los valores originales de forma segura únicamente para esas herramientas, sin exponerlos en la conversación.

Cómo responde ante amenazas

Dependiendo del nivel de seguridad configurado y la gravedad de la amenaza detectada, el sistema puede:- Bloquear la solicitud y mostrar un mensaje de error al usuario.

- Sanitizar el contenido eliminando las partes problemáticas y dejando pasar el resto.

- Registrar el evento en el log de auditoría para revisión posterior.

En el nivel Crítico, las amenazas de gravedad alta y media se bloquean automáticamente. En los niveles Medio y Alto, solo las amenazas de gravedad alta se bloquean; las demás se sanitizan y el flujo continúa.

Buenas prácticas

- Combina ambas capas: escribe guardrails claros en el prompt y habilita la configuración de seguridad. Los guardrails definen el comportamiento esperado del agente; la protección automática cubre amenazas que un prompt por sí solo no puede cubrir.

- Comienza con el nivel Bajo y sube progresivamente. Esto te permite entender las protecciones de cada nivel sin afectar el rendimiento. Si manejas datos financieros, médicos o altamente sensibles, considera el nivel Alto o Crítico.

- Define qué hacer cuando algo falla. La seguridad protege contra amenazas, pero el agente necesita saber cómo responder ante errores inesperados.

- Revisa los logs de auditoría periódicamente para identificar patrones de amenazas y ajustar tus instrucciones o nivel de seguridad si es necesario.