O nodo AI Agent é o componente central para criar conversas autônomas com tecnologia de inteligência artificial no Brain Studio. Ele permite configurar um agente que processa mensagens do usuário, consulta bases de conhecimento, executa ferramentas e gera respostas contextuais de forma autônoma. O painel de configuração está organizado em quatro abas:Documentation Index

Fetch the complete documentation index at: https://docs.jelou.ai/llms.txt

Use this file to discover all available pages before exploring further.

- Geral — Modelo e instruções

- Ferramentas — Ferramentas nativas, personalizadas e MCP

- Contexto — Mensagem inicial, histórico e conhecimento externo

- Avançado — Salvar resposta, modelo de fallback, segurança, expiração, DLP e mais

Geral

A aba Geral contém a configuração essencial do agente.Modelo

Selecione o modelo de linguagem (LLM) que o agente usará para gerar respostas. Considere latência, custo e complexidade da tarefa antes de fazer sua seleção. Os modelos disponíveis incluem: OpenAI- GPT 4.1 Mini: uma variante simplificada do GPT-4.1 otimizada para respostas rápidas com menor demanda de recursos.

- GPT 4.1: uma evolução refinada do GPT-4, com melhor compreensão, raciocínio e precisão.

- GPT 4-o (Azure): uma versão do GPT 4-o hospedada no Azure, focada em estabilidade e desempenho em ambientes corporativos. Suporta visão.

- GPT 4-o Mini: uma versão mais rápida e leve do GPT 4-o, orientada para casos de uso com prioridade em velocidade. Suporta visão.

- GPT 5.2: o modelo da última geração da OpenAI com raciocínio avançado, contexto maior e alta precisão em tarefas complexas.

- Claude 3.5 Sonnet: excelente para tarefas complexas que exigem texto mais elaborado e contextos extensos.

- Claude 4 Sonnet: alta capacidade de raciocínio e análise.

- Claude 4.6 Sonnet: a última geração do Claude, com raciocínio aprimorado e maior precisão.

- Gemini 2.5 Flash: processamento rápido com capacidades multimodais. Suporta visão.

- Gemini 2.5 Pro: raciocínio avançado com capacidades multimodais. Suporta visão.

- Gemini 3 Flash: última geração do Gemini com processamento multimodal otimizado. Suporta visão.

- Llama 4 Scout: modelo ágil e de baixa latência, ideal para ideias rápidas e interações leves.

- Llama 4 Maverick: modelo de alto desempenho projetado para raciocínio exigente e resolução de problemas em múltiplas etapas.

Você também pode adicionar modelos personalizados usando o botão “Adicionar modelo”. Isso permite conectar seus próprios modelos ou modelos de terceiros que não estão na lista predefinida.

Instruções

Defina o comportamento base do agente por meio de um prompt de sistema. As instruções determinam qual papel ele adota, que tom usa e quais passos segue antes de responder. Certifique-se de que sejam concisas, concretas e sem ambiguidade. As instruções suportam interpolação de variáveis usando a sintaxe{{$variable}}, o que permite personalizar dinamicamente o comportamento com base no contexto da conversa.

O campo inclui um contador de caracteres que se ajusta com base no modelo selecionado, pois cada modelo tem um limite máximo diferente.

Ver recomendações e exemplos de prompting

Ferramentas

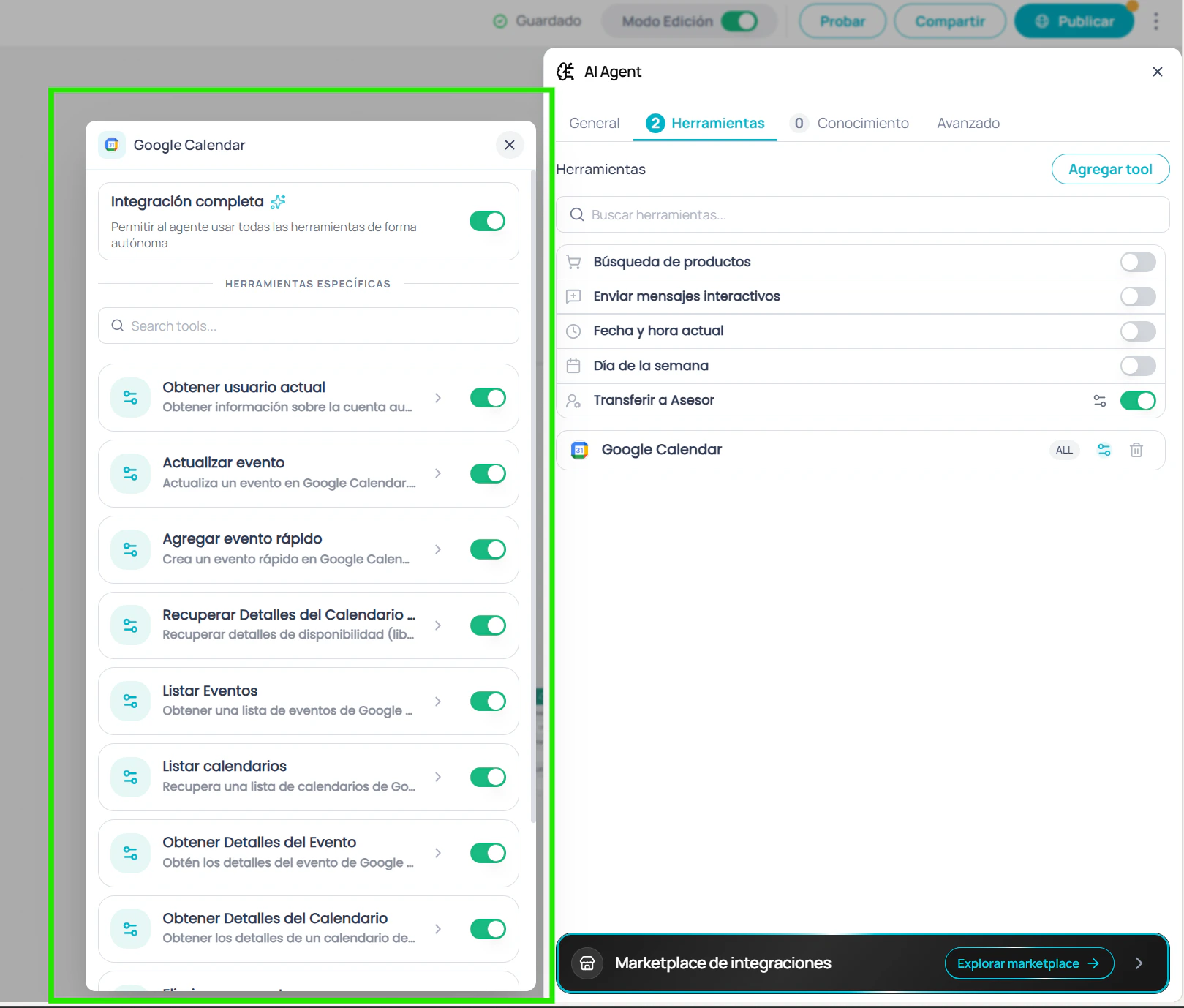

A aba Ferramentas permite adicionar ferramentas que ampliam as capacidades do agente além da geração de texto. O agente decide autonomamente quando invocar cada ferramenta com base no contexto da conversa. Para adicionar ferramentas, clique no botão ”+ Adicionar ferramentas” e selecione as ferramentas que você precisa.Ferramentas nativas

São ferramentas predefinidas integradas à plataforma. Elas são marcadas com o texto “(Nativa)” no seletor:| Ferramenta | Descrição |

|---|---|

| Busca de produtos | Consulta o catálogo de produtos configurado no bot |

| Enviar mensagem interativa | Renderiza botões, listas e respostas rápidas para o usuário |

| Enviar Call to Action | Envia botões CTA com URL, com suporte a WebView |

| Data e hora atual | Obtém a data e hora atual para um fuso horário específico |

| Dia da semana | Calcula o dia correspondente a uma data |

| Transferir para agente | Transfere a conversa para um agente humano ou fila de suporte |

Ferramentas personalizadas

Ferramentas criadas pelo usuário a partir do Brain Studio. Ao adicionar uma ferramenta personalizada, você pode configurar:- Nome e descrição que o modelo usa para decidir quando invocá-la.

- Parâmetros de entrada personalizados.

- Ação na execução: comportamento após a ferramenta ter sido executada.

Ferramentas MCP (Model Context Protocol)

Integre serviços externos usando o padrão MCP. Existem dois tipos de integração:Apps MCP nativas

Aplicativos do marketplace Jelou que são instalados diretamente na plataforma. Cada app MCP pode ser configurada em dois modos:- Modo integração: habilita todas as ferramentas do app de uma vez.

- Modo granular: permite selecionar ferramentas individuais do app e configurar cada uma separadamente.

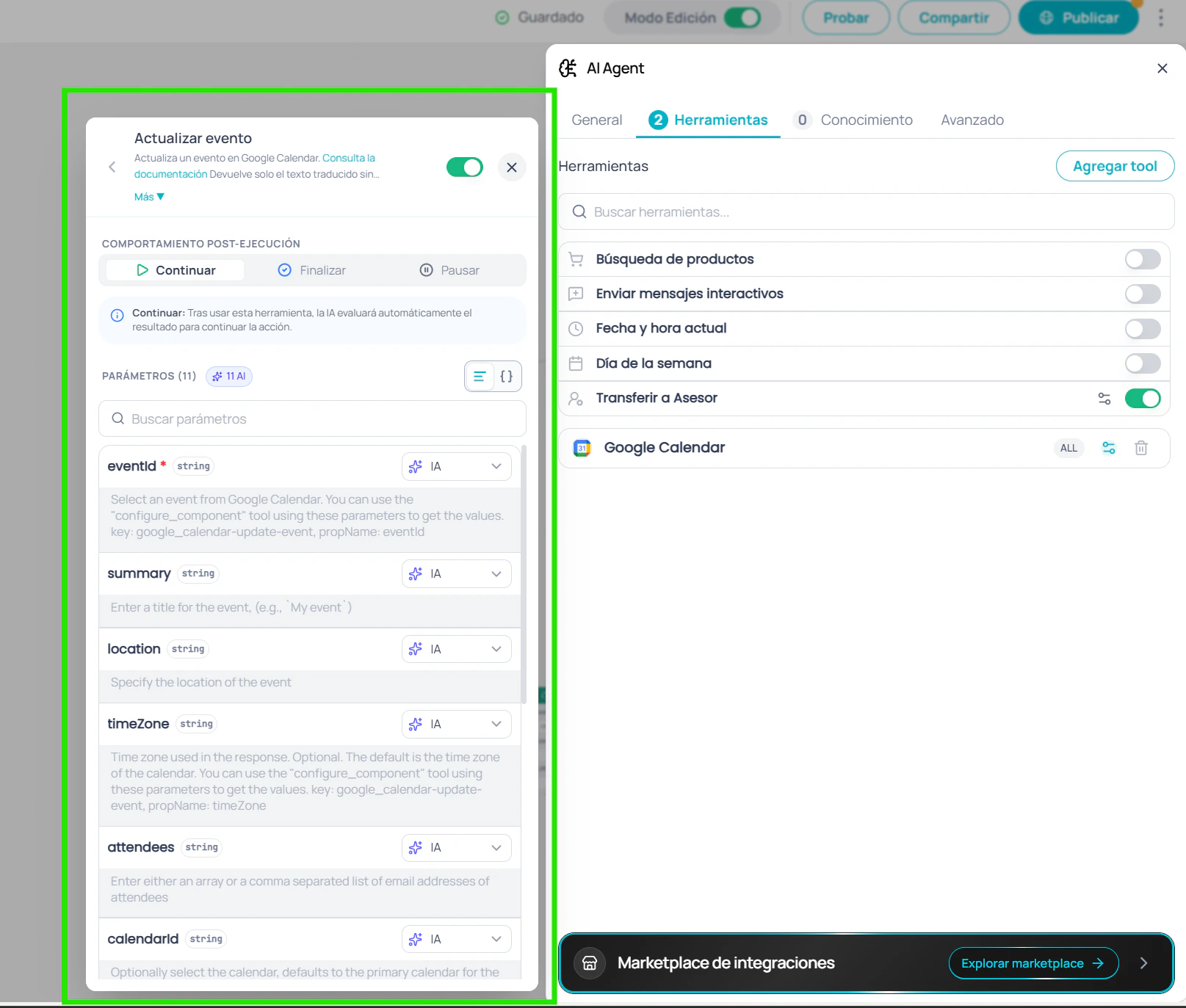

Parâmetros padrão

No modo granular, cada ferramenta individual permite configurar parâmetros padrão. Clique em uma ferramenta para abrir sua visualização detalhada, onde você pode:- Ver todos os parâmetros da ferramenta com seu tipo, descrição e se são obrigatórios.

- Definir valores padrão que o agente usará em cada invocação, em vez de deixar a IA decidir.

- Usar o seletor de variáveis para injetar valores dinâmicos do fluxo (ex:

{{$context.email}}). - Alternar entre visualização de formulário e editor JSON para editar todos os parâmetros de uma vez.

- Pesquisar parâmetros por nome quando a ferramenta tem muitos.

| Indicador | Significado |

|---|---|

| Manual | Tem um valor definido por você — o agente sempre usará esse valor |

| Auto | Sem valor definido — o agente decide o valor em cada invocação |

Servidores MCP externos

Conexões com seus próprios servidores MCP via URL personalizada.Adicionar cabeçalhos (opcional)

Configure cabeçalhos personalizados (nome e valor) para autenticação ou outros metadados.

Ações de ferramentas

Cada ferramenta (nativa, personalizada ou MCP) pode configurar uma ação que é executada após ser invocada:| Ação | Comportamento |

|---|---|

| Nenhuma | O agente continua a conversa normalmente |

| Encerrar função | A execução do fluxo termina após usar a ferramenta |

| Pausar interação | A conversa fica pausada até ser retomada externamente |

Contexto

A aba Contexto centraliza a configuração do contexto de entrada do agente: como cada conversa começa, quantas mensagens anteriores ele lembra e quais fontes de conhecimento consulta para gerar suas respostas.Mensagem inicial

Define o texto que o agente recebe como primeiro turno do usuário quando o nodo começa a ser executado. Essa configuração determina com quais informações o agente começa para gerar sua primeira resposta.| Opção | Comportamento | Quando usar |

|---|---|---|

| Passar a última mensagem | O agente recebe a última mensagem da conversa como entrada inicial | A maioria dos casos: atendimento ao cliente, suporte técnico, consultas gerais |

| Sem mensagem do usuário | Nenhum turno do usuário é enviado ao modelo; o agente responde baseando-se apenas em suas instruções de sistema | Quando não há mensagem do usuário relevante para passar ao agente (campanhas HSM, workflows automatizados, pós-coleta de dados) |

| Personalizado | Mostra um campo de texto com seletor de variáveis para definir um valor personalizado | Quando você precisa combinar variáveis ou enviar um contexto específico ao agente |

Exemplos por caso de uso

Passar a última mensagem — Atendimento ao cliente

Um usuário escreve “Qual é o horário de atendimento?” e o agente o recebe diretamente como entrada, gerando uma resposta baseada em sua base de conhecimento.

Sem mensagem do usuário — Quando não há consulta real do usuário

Use esta opção quando a última mensagem disponível não representa uma consulta real do usuário. Cenários comuns:

- Pós-campanha HSM: o usuário respondeu a um template de WhatsApp tocando em um botão como “Sim, tenho interesse”. Esse payload não é uma consulta — o agente deve iniciar a partir de suas instruções e do contexto do fluxo.

- Workflows automatizados: o fluxo foi disparado por um webhook, scheduler ou API externa. Não há mensagem do usuário porque nenhum usuário escreveu nada.

-

Pós-coleta de dados: nodos de Input anteriores já coletaram nome, número de pedido, etc. A última mensagem é um dado (ex:

"ORD-12345"), não uma pergunta. O agente deve responder com base nas informações já armazenadas na memória.

Neste modo, o agente gera sua primeira resposta baseando-se apenas em suas instruções de sistema. Se precisar que o agente cumprimente o usuário, configure isso nas instruções do agente.

Personalizado — Contexto personalizado com variáveis

Permite construir uma mensagem de entrada combinando variáveis do fluxo. Por exemplo, para passar informações de contexto ao agente:

Ao selecionar Personalizado, o campo suporta interpolação de variáveis com a sintaxe

{{$variable}} e tem um limite de 100 caracteres. Use o seletor de variáveis para explorar as variáveis disponíveis no seu fluxo.Lembrar mensagens anteriores

Quando habilitado, o agente inclui como contexto as últimas N mensagens da conversa cada vez que inicia. Isso permite manter a coerência conversacional quando o usuário retoma uma sessão após um intervalo.Bloco de upload

O bloco de upload unificado aceita documentos e imagens na mesma interação. Você pode adicionar arquivos de três maneiras:- Arrastar e soltar arquivos diretamente no bloco

- Clicar no bloco para abrir o seletor de arquivos

- Colar uma URL no campo de link na parte inferior do bloco (suporta os mesmos formatos de documento e imagem listados abaixo)

| Tipo | Formatos suportados | Tamanho máximo |

|---|---|---|

| Documentos | .pdf, .xlsx, .md, .txt, .json, .csv | 2 MB por arquivo |

| Imagens | .jpg, .jpeg, .png | 10 MB por arquivo |

Os documentos são processados um de cada vez. Se você selecionar ou arrastar vários documentos simultaneamente, apenas o primeiro será processado e você receberá um aviso para carregar os demais individualmente. Imagens, por outro lado, são processadas em lote.

Documentos

Quando você faz upload de um documento, um painel se abre onde você define seu nome (máximo 30 caracteres) e uma descrição opcional que ajuda o agente a entender o conteúdo do arquivo. Após o upload, você pode editar seus metadados ou excluí-lo da lista.Imagens

As imagens são carregadas diretamente sem etapas adicionais e aparecem como miniaturas abaixo do bloco de upload. Você pode carregar até 3 imagens por agente.- Clique em uma miniatura para visualizá-la em tela cheia

- Passe o cursor sobre uma miniatura para ver o botão de exclusão

Datastores

Conecte bancos de dados Datum para que o agente possa consultar informações estruturadas em tempo real:- Selecione o datastore a conectar

- Configure as operações permitidas no banco de dados

É recomendável sempre carregar documentos na aba Contexto para ancorar as respostas do agente à documentação oficial do seu negócio. Atribua descrições claras a cada arquivo carregado para maximizar a eficácia. O modelo priorizará informações dos seus arquivos e datastores em relação ao seu conhecimento geral, reduzindo drasticamente o risco de alucinações.

Contexto externo

Permite retomar este nó a partir de um sistema externo por meio da API de retomada. Útil para workflows que requerem processamento assíncrono externo, como validações, pagamentos ou aprovações.O

executionId está disponível como {{$context.executionId}} dentro do fluxo e tem validade de 24 horas.Avançado

A aba Avançado contém configurações adicionais para um controle mais preciso do comportamento do agente.Salvar resposta

Permite armazenar a última resposta do agente em uma variável para uso em nodos subsequentes do fluxo.

A variável estará disponível como

{{$context.ai_agent_response}} nos nodos subsequentes do fluxo.

Modelo de fallback

Selecione um modelo alternativo que será usado automaticamente se o modelo principal falhar ou estiver indisponível.Opções de processamento

Opções independentes para habilitar capacidades adicionais para mensagens que o usuário envia durante a conversa:| Opção | Descrição |

|---|---|

| Suporte a PDF | Permite que o agente leia e processe documentos PDF enviados pelo usuário durante a conversa (somente texto, não imagens dentro do PDF) |

| Ler URLs de imagens | Habilita o agente para processar imagens que o usuário envia como URL com texto descritivo durante a conversa |

| Suporte a payload de resposta rápida | Permite que o agente interprete o payload de respostas rápidas de mensagens interativas |

Essas opções se aplicam a arquivos que o usuário final envia durante a conversa. Imagens e documentos que você configura como contexto do agente são gerenciados na aba Contexto.

Resposta em várias mensagens

Divide a resposta do agente em bolhas separadas quando contém quebras de parágrafo (\n\n), URLs de mídia ou listas. URLs de imagem, vídeo, áudio ou documento são enviadas como bolhas de mídia independentes conforme o canal, enquanto listas numeradas são mantidas juntas.

Ativado por padrão para agentes criados a partir de 24 de abril de 2026. Agentes anteriores mantêm o comportamento anterior (uma única bolha) até que você ative o toggle manualmente.

Segurança (Guardrails)

Configure o nível de proteção do agente contra uso indevido, injeção de prompt e solicitações fora do escopo.Selecionar o nível de segurança

Escolha o preset que melhor se adapta ao seu caso de uso:

| Nível | Descrição |

|---|---|

| Baixo | Proteção mínima, maior flexibilidade de resposta |

| Médio | Equilíbrio entre segurança e flexibilidade (recomendado) |

| Alto | Proteção estrita, restringe respostas fora do escopo |

| Crítico | Proteção máxima, ideal para contextos regulados |

Expiração

Configure um limite de tempo para a sessão do agente. Se o usuário não responder dentro do tempo configurado, a sessão expira automaticamente.DLP (Prevenção de Perda de Dados)

Habilite a detecção e mascaramento automático de informações sensíveis nas conversas do agente.Selecionar tipos de dados sensíveis

Escolha quais tipos de informação devem ser automaticamente detectados e mascarados:

| Tipo de dado | Valor de substituição padrão |

|---|---|

| Número de cartão de crédito | [CreditCardNumber] |

| Número de trilha de cartão de crédito | [CreditCardTrackNumber] |

| Endereço de e-mail | [EmailAddress] |

| Número de conta financeira | [FinancialAccountNumber] |

| Endereço IP | [IpAddress] |

| Localização | [Location] |

| Coordenadas geográficas | [LocationCoordinates] |

| Número de telefone | [PhoneNumber] |

| Data | [Date] |

| Nome de pessoa | [PersonName] |

Mensagem de acompanhamento

Quando habilitada, permite que o agente envie mensagens de acompanhamento para manter a conversa ativa caso o usuário não responda.Exemplo de configuração

Um fluxo de configuração típico para um agente de atendimento ao cliente:Configurar Geral

Selecione GPT-4.1 como modelo e escreva instruções claras definindo o papel, tom e escopo do agente.

Adicionar Ferramentas

Habilite Transferir para agente para escalonar conversas complexas, Busca de produtos se o agente lida com consultas de catálogo, e Enviar mensagem interativa para mostrar opções ao usuário.

Configurar Contexto

Selecione Passar a última mensagem como mensagem inicial, faça upload do documento de FAQ em formato PDF, adicione imagens de referência se o modelo suportar visão, e conecte o datastore de produtos se aplicável.